Los investigadores de Apple han desarrollado un modelo de inteligencia artificial que reconstruye un objeto 3D a partir de una sola imagen, ajustando reflejos, luces y otros efectos para diferentes ángulos de visión. Aquí están los detalles.

Un poco de contexto

Aunque el concepto de espacio latente no es precisamente nuevo en el aprendizaje automático, se ha vuelto más popular en los últimos años con la explosión de modelos de IA basados en la arquitectura Transformer y, más recientemente, con los modelos mundiales.

En resumen (y a riesgo de ser un poco impreciso al explicar el panorama general), “espacio latente” o “espacio de incrustación” son términos que describen lo que sucede cuando:

- La representación numérica de sus ideas;

- Organiza estos números en un espacio multidimensional, permitiendo calcular la distancia entre ellos para cada dimensión diferente.

Si esto todavía suena demasiado abstracto, un ejemplo clásico es la representación matemática de la ficha “rey”, restando la representación matemática de la ficha “hombre”, sumando la representación matemática de la ficha “dama” y se obtiene la región multidimensional general de la ficha “reina”.

En términos prácticos, almacenar información como una representación matemática en el espacio latente hace que sea más rápido y menos costoso computacionalmente medir la distancia entre ellos y estimar la probabilidad de lo que debería generarse.

Aquí hay un video corto que explica el espacio latente usando una analogía diferente:

Aunque los ejemplos anteriores se centran en almacenar texto en espacio latente, el mismo concepto se puede aplicar a muchos otros tipos de datos. Lo que nos lleva a la investigación de Apple.

LiTo: tokenización del campo de luz de superficie

En el nuevo estudio de Apple, el título LiTo: tokenización del campo de luz de superficieLos investigadores “proponen una representación latente en 3D que modela conjuntamente la geometría del objeto y la apariencia dependiente de la escena”.

En otras palabras, desarrollaron una forma de representar el espacio latente, no sólo cómo reconstruir un objeto tridimensional, sino también cómo interactúa la luz con él cuando aparece desde diferentes ángulos.

Según explican:

La mayoría de los trabajos anteriores se centran en reconstruir la geometría 3D o predecir la apariencia difusa independiente de la vista y, por lo tanto, tienen dificultades para capturar efectos realistas dependientes de la vista. Utilizando nuestro enfoque, las imágenes de profundidad RGB proporcionan una muestra de un campo de luz superficial. Al codificar submuestras aleatorias de este campo de luz superficial en un conjunto compacto de vectores latentes, nuestro modelo aprende a representar tanto la geometría como la apariencia dentro de un espacio oculto 3D unificado. Esta representación reproduce efectos dependientes de la escena, como reflejos especulares y reflejos de Fresnel bajo una iluminación compleja.

Es más, los investigadores pudieron entrenar el modelo para que pudiera hacer esto a partir de una sola imagen, en lugar del enfoque más común que requiere imágenes desde diferentes ángulos para permitir la reconstrucción 3D.

Aunque todo el proceso es muy técnico y se explica en detalle en el estudio, la idea básica es en realidad relativamente simple, una vez que se comprende cómo funciona el espacio latente:

- Primero, un codificador comprime la información del objeto en una representación compacta en el espacio latente. Entonces, en lugar de almacenar cada detalle visible, aprende una descripción matemática condensada de la forma del objeto y cómo la luz interactúa con su superficie.

- Luego, un decodificador hace lo contrario. Reconstruye el objeto 3D completo a partir de esa representación compacta, creando tanto la geometría como una representación de cómo deberían aparecer los efectos de iluminación, como reflejos y luces, desde diferentes ángulos de visión.

Entrenamiento LiTo

Para entrenar el modelo, los investigadores seleccionaron miles de objetos renderizados desde 150 ángulos de visión diferentes y 3 condiciones de iluminación.

Luego, en lugar de introducir toda esa información directamente en el modelo, el sistema selecciona aleatoriamente pequeños subconjuntos de estas muestras y los comprime en una representación latente.

A continuación, se entrenó el decodificador a partir de ese subconjunto de datos, reconstruyendo el objeto completo y su apariencia bajo diferentes ángulos y condiciones de iluminación.

Durante el entrenamiento, el sistema aprende una representación implícita que captura tanto la geometría del objeto como cómo cambia su apariencia según la dirección de observación.

Una vez hecho esto, entrenan aún más un modelo que toma una sola imagen de un objeto y predice la representación latente correspondiente. A continuación, el decodificador reconstruye todo el objeto 3D, incluido cómo cambia su apariencia a medida que cambia el ángulo de visión.

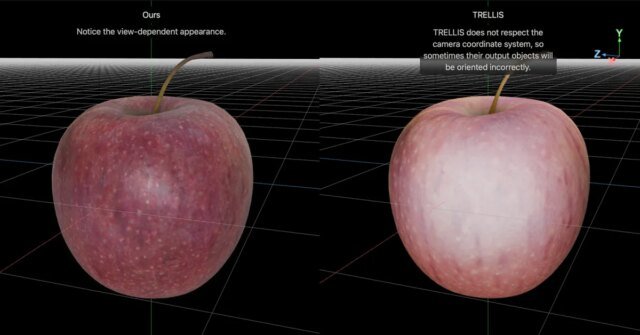

Aquí una comparativa de algunas reconstrucciones entre LiTo y un modelo llamado TRELLIS, como el de Apple pagina del proyecto:

estar seguro Ver la página del proyectoDonde puede cargar una comparación interactiva lado a lado entre LiTo y TRELLIS, como se ve en la imagen destacada de esta publicación.

Y para el estudio completo, Sigue este enlace.