Un nuevo estudio publicado el 24 de marzo RadiologíaJournal of the Radioological Society of North America (RSNA), muestra que tanto los radiólogos como los modelos multimodales de lenguaje grande (LLM) tienen dificultades para diferenciar los rayos X reales de las imágenes “deepfake” generadas por inteligencia artificial (IA). Los hallazgos plantean preocupaciones sobre los riesgos que plantean las imágenes médicas sintéticas y resaltan la necesidad de mejores equipos y capacitación para proteger la precisión de las imágenes médicas y preparar a los profesionales de la salud para reconocer los deepfakes.

Un “deepfake” es un video, fotografía, imagen o archivo de audio que parece auténtico pero que ha sido creado o modificado mediante inteligencia artificial.

“Nuestro estudio demuestra que estos rayos X falsos son lo suficientemente realistas como para engañar a los radiólogos, los especialistas en imágenes médicas mejor capacitados, incluso cuando sabían que había imágenes generadas por IA”, dijo el autor principal del estudio, Mikael Torzman, MD, becario postdoctoral de la Escuela de Medicina Icahn en Mount Sinai, Nueva York. “Esto crea una vulnerabilidad de alto riesgo para demandas fraudulentas si, por ejemplo, una fractura fabricada no se puede distinguir de una real. También existe un importante riesgo de ciberseguridad si los piratas informáticos obtienen acceso a la red de un hospital e inyectan imágenes sintéticas para manipular diagnósticos de pacientes o recuperar grandes cantidades de registros médicos digitales”.

Descripción del estudio y examen de imágenes.

En el estudio participaron 17 radiólogos de 12 instituciones en seis países (EE.UU., Francia, Alemania, Türkiye, Reino Unido y Emiratos Árabes Unidos). Su experiencia va desde principiantes hasta expertos con hasta 40 años en la práctica. En total, el estudio examinó 264 imágenes de rayos X, divididas equitativamente entre escaneos reales e imágenes generadas por IA.

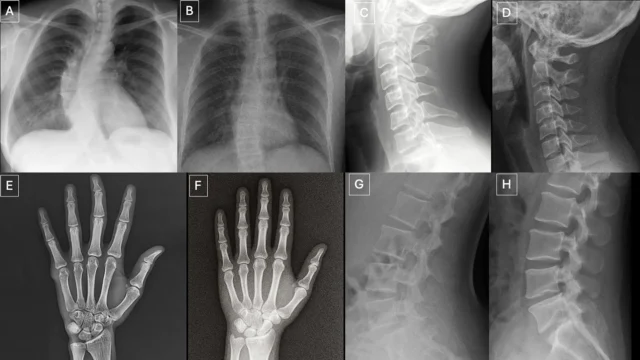

Los participantes revisaron dos conjuntos separados de imágenes sin superposición. Un conjunto consta de una combinación de imágenes reales y rayos X generados por ChatGPT de diferentes partes del cuerpo. El segundo conjunto se centra en las radiografías de tórax, mitad reales y mitad generadas mediante rayos X, un modelo de difusión de IA generativa de código abierto desarrollado por investigadores de Stanford Medicine.

Precisión de detección para radiólogos e IA

Cuando a los radiólogos no se les dijo que se incluían imágenes falsas, solo el 41% reconoció los rayos X generados por IA después de evaluar su calidad técnica. Una vez que se les informó que había imágenes sintéticas, su precisión promedio para distinguir el original del falso aumentó al 75%.

El rendimiento varía mucho entre los individuos. Los radiólogos identificaron correctamente entre el 58% y el 92% de las imágenes generadas por ChatGPT. Los sistemas de IA han mostrado limitaciones similares. Cuatro LLM multimodales: GPT-4o (OpenAI), GPT-5 (OpenAI), Gemini 2.5 Pro (Google) y Llama 4 Maverick (Meta) lograron tasas de precisión que oscilaron entre el 57% y el 85%. Incluso ChatGPT-4o, que se utilizaba para generar imágenes deepfake, no pudo detectarlas, aunque funcionó mejor que los otros modelos.

Para las radiografías de tórax generadas por RoentGen, los radiólogos lograron tasas de precisión de entre el 62 % y el 78 %, mientras que los modelos de IA oscilaron entre el 52 % y el 89 %.

La experiencia no garantiza la identificación.

El estudio no encontró ningún vínculo entre los años de experiencia de un radiólogo y la capacidad de detectar radiografías falsas. Sin embargo, los radiólogos musculoesqueléticos obtuvieron resultados significativamente mejores que otros subespecialistas.

Pistas visuales en rayos X deepfake

Los investigadores han identificado varios patrones que pueden aparecer en imágenes sintéticas.

“Las imágenes médicas deepfake a menudo parecen demasiado perfectas”, afirma el Dr. Tordzman. “Los huesos son excesivamente lisos, las espinas son inusualmente rectas, los pulmones son excesivamente simétricos, los patrones de los vasos sanguíneos son excesivamente uniformes y las grietas son inusualmente claras y consistentes, a menudo confinadas a un lado del hueso”.

Riesgos y protecciones para imágenes médicas.

Los resultados resaltan graves riesgos si se hacen un mal uso de los rayos X deepfake. Las imágenes falsas pueden utilizarse en casos legales o insertarse en los sistemas hospitalarios para influir en los diagnósticos e interrumpir la atención.

Para mitigar estas amenazas, los investigadores recomiendan una seguridad digital sólida. Estos incluyen marcas de agua invisibles incrustadas directamente en la imagen y firmas criptográficas adjuntas al tecnólogo cuando se toma la imagen, lo que puede ayudar a verificar la autenticidad.

El futuro de la IA en imágenes médicas

“Posiblemente sólo estamos viendo la punta del iceberg”, dijo el Dr. Tordzman. “El siguiente paso lógico en esta evolución es la generación mediante IA de imágenes sintéticas en 3D, como la tomografía computarizada y la resonancia magnética. Los conjuntos de datos educativos y las herramientas de detección son fundamentales en este momento”.

Para apoyar la educación y la concientización, los investigadores han publicado un conjunto de datos seleccionados de DeepFake que incluye cuestionarios interactivos con fines de capacitación.