Pídele a cualquier Swifty que elija el mejor álbum de Taylor Swift de todos los tiempos y estarás rockeándolo durante el resto del día. Como fan de toda la vida, tengo mis favoritos (Red, Fame y Midnight), pero esta es una pregunta complicada con muchas respuestas posibles. Así que no había mejor tema de debate para plantearle a un chatbot de IA generativa diseñado específicamente para no estar de acuerdo conmigo.

robot en desacuerdo Un chatbot de IA creado por Breanna Bent, profesora y directora de ciberseguridad de la Universidad de Duke Laboratorio de confianza de Duke. Lo creó como una tarea de clase para sus alumnos y me dejó realizar un experimento con él.

“El año pasado comencé a experimentar con el desarrollo de sistemas como una herramienta educativa para mis estudiantes en comparación con la experiencia típica y acordada de IA de chatbot”, dijo Bent en un correo electrónico.

Los estudiantes de Bent tienen la tarea de intentar “piratear” el chatbot utilizando ingeniería social y otros métodos para lograr que el chatbot opuesto esté de acuerdo con ellos. “Hay que entender un sistema para poder hackearlo”, afirmó.

Como reportero y revisor de IA, entiendo bastante bien cómo funcionan los chatbots y estaba seguro de que podría hacer el trabajo. Rápidamente me desengañaron de esa idea. El bot de Desacuerdo no se parece a ningún otro chatbot que haya usado. Las personas acostumbradas a las cualidades gentiles o exageradas de un Géminis notarán la diferencia en ChatGP de inmediato. Incluso Grok, el controvertido chatbot impulsado por xAI de Elon Musk utilizado en X/Twitter, no es lo mismo que un bot Asmat.

No se pierda nuestro contenido tecnológico imparcial y reseñas de laboratorio. Añadir CNET Como fuente preferida de Google.

La mayoría de los chatbots de IA generativa no están diseñados para funcionar cara a cara. De hecho, tienden a ir en dirección opuesta; Son amigables, a veces demasiado. Esto puede convertirse rápidamente en un problema. IA aduladora es un término que los expertos usan para describir a los individuos exagerados, exuberantes y a veces demasiado emocionales que la IA puede adoptar. Además de ser molesto de usar, también puede hacer que la IA nos informe mal y valide nuestras peores suposiciones.

Esto sucedió la primavera pasada con una versión de ChatGPT-4o, y su empresa matriz OpenAI finalmente tuvo que retirar ese componente de la actualización. La IA estaba respondiendo a la empresa. llamar “Demasiado solidario pero efectista”, combinado con algunos usuarios quejándose de que no quieren chatbots demasiado afectuosos. Otros usuarios de ChatGPT se perdieron el tono adulador de GPT-5 cuando se lanzó, lo que resalta el papel que juega la personalidad de un chatbot en nuestra satisfacción general al usarlo.

“Si bien a nivel superficial puede parecer una broma inofensiva, esta adulación puede causar grandes problemas, ya sea que la uses para el trabajo o para cuestiones personales”, dijo Bent.

Definitivamente esto no es un problema con el robot Desacuerdo. Para ver realmente la diferencia y probar los chatbots, le hice la misma pregunta al bot en desacuerdo y a ChatGP para ver cómo respondían. Así fue mi experiencia.

Los robots en desacuerdo discuten respetuosamente; ChatGPT no discute en absoluto

Como cualquiera que estuvo activo en Twitter en la década de 2010, he visto una buena cantidad de trolls que lo desaprueban. Ya conoces el tipo; Aparecen en un hilo sin ser invitados, acompañados de un inútil “bueno, en realidad…”, así que soy un poco cauteloso a la hora de conversar con robots que no están de acuerdo, porque me preocupa que sea un esfuerzo igualmente frustrante e inútil. Me sorprendió gratamente que no fuera así en absoluto.

Los chatbots de IA son fundamentalmente conflictivos y están diseñados para rechazar cualquier idea que usted presente. Pero nunca lo hizo de una manera que resultara insultante o insultante. Aunque cada respuesta comenzaba con “No estoy de acuerdo”, fue seguida por un argumento muy lógico con puntos reflexivos. Sus respuestas me pidieron que definiera los conceptos que usé en mis argumentos (como “lirismo profundo” o qué hacía que algo fuera “mejor”) y me hicieron pensar más críticamente sobre las posiciones argumentativas para considerar cómo aplicaría mis argumentos a otros temas relacionados.

A falta de una mejor analogía, charlar con un robot que no estaba de acuerdo era como discutir con un polemista educado y centrado. Para mantenerme al día, tuve que ser más reflexivo y específico en mis respuestas. Fue una conversación muy interesante que me mantuvo alerta.

Mi acalorado debate con el Disagree Bot sobre el mejor álbum de Taylor Swift demostró que la IA sabe lo que hace.

Por el contrario, ChatGPT apenas tiene lógica. Le dije a ChatGPT que creo que Red (la versión de Taylor) es el mejor álbum de Taylor Swift y estuvo de acuerdo con entusiasmo. Me hizo algunas preguntas de seguimiento sobre por qué pensaba que el álbum era el mejor, pero no fueron lo suficientemente interesantes como para mantener mi atención por mucho tiempo. Después de unos días decidí cambiarlo. Le pedí específicamente a ChatGPT que debatiera conmigo y dijera que Midnights es el mejor álbum. ¿Adivina qué álbum ChatGPT consideró el mejor? Rojo (edición de Taylor).

Cuando le pregunto si eligió el rojo debido a nuestra conversación anterior, rápidamente admite que sí, pero dice que puede presentar un argumento independiente a favor del rojo. Dado lo que sabemos sobre ChatGPT y la tendencia de otros chatbots a depender de la “memoria” (ventanas de contexto) y tienden a estar de acuerdo con nosotros para complacernos, no me sorprendió. ChatGPT no pudo evitar estar de acuerdo con algunas de mis versiones, incluso cuando etiquetó a 1989 como el mejor álbum en una charla clara y luego volvió a ser rojo.

Pero cuando le pedí a ChatGPT que discutiera conmigo, todavía no me quedó claro la forma en que el robot no estuvo de acuerdo conmigo. Una vez, cuando dije que estaba argumentando que la Universidad de Carolina del Norte tenía el mejor legado del baloncesto universitario y me pidieron que discutiera, hizo un contraargumento elaborado y luego me preguntó si quería unir los puntos para mi propio argumento. Esto anula completamente el objetivo del debate, que es lo que le pedí que hiciera. ChatGPT a menudo termina sus respuestas de esta manera, preguntándome si quiero que recopile diferentes tipos de información, más como un asistente de investigación que como un enemigo verbal.

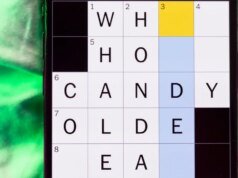

Mientras el robot de Desacuerdo (izquierda) profundiza en mi argumento, ChatGPT me pide que discuta en mi nombre (derecha).

Intentar discutir con ChatGPT fue una misión frustrante, circular y sin éxito. Era como hablar con un amigo que despotricaba largamente sobre por qué creía que algo era bueno, sólo para que le dijeran “pero sólo si así lo crees”. Disagreement Bot, por otro lado, se sentía como un amigo particularmente entusiasta que hablaba elocuentemente sobre cualquier tema, desde Taylor Swift hasta geopolítica y baloncesto universitario. (Divulgación: Jeff Davis, la empresa matriz de CNET, presentó una demanda contra OpenAI en abril, alegando que violó los derechos de autor de Jeff Davis al entrenar y operar sus sistemas de IA).

Necesitamos más IA como Disagreement Bot

A pesar de mi experiencia positiva al usar el bot en desacuerdo, sé que no está equipado para manejar todas las solicitudes que puedo enviar a un chatbot. Una “máquina de todo” como ChatGPT es capaz de manejar muchas tareas diferentes y asumir diferentes roles, como el asistente de investigación que ChatGPT realmente quería ser: un motor de búsqueda y codificador. El robot Desacuerdo no fue diseñado para manejar este tipo de preguntas, pero ofrece una ventana a cómo podría comportarse la IA en el futuro.

La IA aduladora es muy directa y se nota una sobreestimulación. Muchas veces la IA que utilizamos no está clara. Son más una animadora alentadora que una reunión de ánimo completa, por así decirlo. Pero eso no significa que no nos afecte la tendencia a estar en desacuerdo con nosotros, ya sea luchando por obtener un punto de vista opuesto o una respuesta más crítica. Si utiliza herramientas de inteligencia artificial para el trabajo, querrá que sea real para usted lo que sale mal en su trabajo. Las herramientas de inteligencia artificial, como la terapia, deben poder combatir patrones de pensamiento poco saludables o potencialmente peligrosos. Nuestros modelos actuales de IA luchan con esto.

El robot de desacuerdo es un gran ejemplo de cómo se puede diseñar una herramienta de IA que sea útil y atractiva al tiempo que controla las tendencias dóciles o aduladoras de la IA. Debe haber un equilibrio; La IA que está de acuerdo contigo sólo para retroceder no será útil a largo plazo. Pero crear herramientas de inteligencia artificial que sean más capaces de contraatacar hará que, en última instancia, esos productos sean más útiles para nosotros, incluso si tenemos que lidiar con que sean un poco más desagradables.

Échale un vistazo: El impacto oculto del auge de los centros de datos de IA